Spark大数据分析中的图算法实践 以中心性算法为例的数据处理流程

引言

在大数据时代,复杂网络分析已成为揭示系统内在结构与动态行为的关键手段。Apache Spark,作为一个快速、通用的大规模数据处理引擎,凭借其内存计算与容错特性,为海量图数据的处理与分析提供了强大支持。特别是其图计算库GraphX,实现了高效的图并行计算模型。本文将聚焦于Spark平台上的图算法应用,深入探讨中心性算法及其在数据处理全流程中的实践。

一、Spark与GraphX:图数据处理的基石

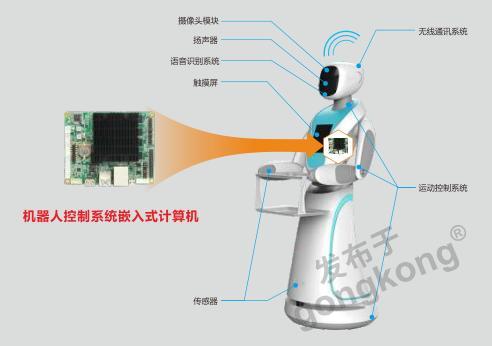

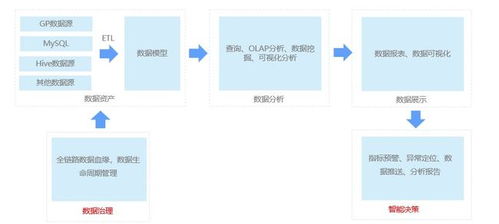

Spark GraphX通过属性图(Property Graph)模型抽象图数据。一个属性图由顶点(Vertex)和边(Edge)集合构成,顶点和边均可附带任意属性。其核心优势在于能够与Spark生态系统无缝集成(如Spark SQL、DataFrame),实现图数据与表数据的统一处理。在Spark中处理图数据通常遵循以下通用流程:

- 数据加载与预处理:从HDFS、Hive、HBase或本地文件系统等源读取原始数据,通常为边列表或邻接表格式。利用Spark Core或Spark SQL进行数据清洗、去重、格式转换。

- 图构建:将预处理后的数据(RDD或DataFrame)转化为

VertexRDD和EdgeRDD,并调用Graph()方法构建属性图对象。 - 图计算与分析:应用GraphX提供的API或自定义算法进行图计算。

- 结果输出与可视化:将计算结果(如顶点的中心性分数)持久化存储或传递给其他系统进行可视化展示。

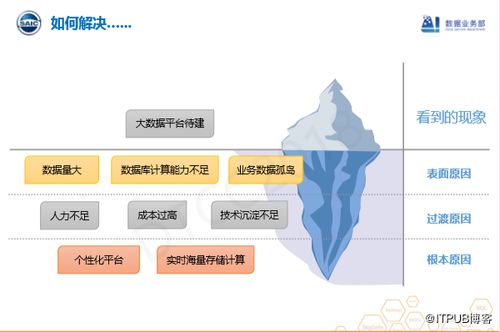

二、中心性算法:度量节点影响力的核心

中心性算法旨在识别网络中最重要的节点,是社交网络分析、网页排序、基础设施脆弱性评估等领域的核心工具。GraphX原生支持或可通过Pregel API高效实现多种经典中心性算法。

1. 度中心性(Degree Centrality)

衡量与一个节点直接相连的边的数量。在有向图中可分为入度和出度。在GraphX中,可通过graph.degrees、graph.inDegrees、graph.outDegrees直接计算,是最高效的中心性指标。

2. 接近中心性(Closeness Centrality)

衡量一个节点到网络中所有其他节点的平均最短路径距离的倒数。值越大,表示该节点越“中心”。其计算依赖于全图的最短路径,可使用ShortestPaths算法先计算所有节点对的最短路径,再进行聚合。

3. 介数中心性(Betweenness Centrality)

衡量一个节点位于网络中其他节点对最短路径上的次数。高介数中心性的节点通常是网络中的“桥梁”或“瓶颈”。GraphX未提供内置实现,但可利用基于Pregel模型的自定义迭代算法,通过模拟所有节点对(或抽样节点对)的最短路径来计算,计算复杂度较高。

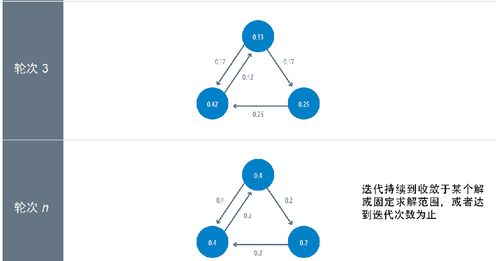

4. PageRank算法

由Google提出的用于衡量网页重要性的算法,本质上是一种特征向量中心性。它考虑链接的数量和质量。GraphX提供了静态和动态两种版本的PageRank实现(graph.pageRank),是处理大规模链接分析的利器。

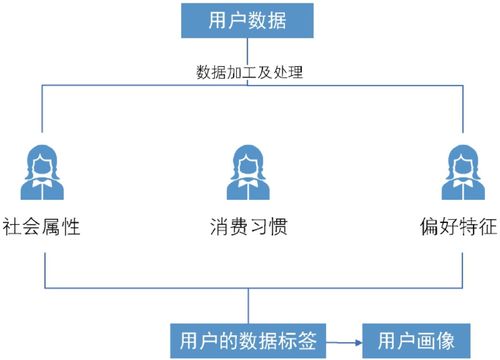

三、实践案例:社交网络影响力分析的数据处理流程

假设我们有一个社交平台的关注关系数据集(user<em>id, follows</em>user_id),目标是找出最具影响力的用户。

步骤1:数据加载与清洗(使用Spark SQL)

val spark = SparkSession.builder().appName("InfluenceAnalysis").getOrCreate()

// 读取原始边数据

val edgesDF = spark.read.csv("hdfs://path/to/follows.csv").toDF("src", "dst")

// 数据清洗:去重、过滤自环、处理空值

val cleanEdgesDF = edgesDF.filter($"src".isNotNull && $"dst".isNotNull && $"src" =!= $"dst").distinct()步骤2:构建属性图

import org.apache.spark.graphx._

// 将DataFrame转换为RDD[Edge]

val edgesRDD = cleanEdgesDF.rdd.map(row => Edge(row.getAsString.toLong, row.getAsString.toLong, 1.0))

// 构建图(默认顶点属性为1)

val graph = Graph.fromEdges(edgesRDD, defaultValue = 1)步骤3:应用中心性算法计算

`scala

// 计算PageRank(迭代10次,阻尼系数0.85)

val pageRankGraph = graph.pageRank(0.85, 10)

// 获取顶点ID及其PageRank值

val influentialUsers = pageRankGraph.vertices.sortBy(-.2).take(10)

// 计算入度中心性(被关注数)

val inDegreeRDD = graph.inDegrees`

步骤4:结果整合与输出

// 将PageRank和入度结果关联起来,形成综合影响力视图

val userInfluence = pageRankGraph.vertices.join(inDegreeRDD).map{

case (userId, (prScore, inDeg)) => (userId, prScore, inDeg)

}

// 转换为DataFrame以便于查看或写入Hive

val resultDF = spark.createDataFrame(userInfluence).toDF("userid", "pagerank", "indegree")

resultDF.write.parquet("hdfs://path/to/influence_result")四、性能优化与挑战

在处理超大规模图时,需注意:

- 分区策略:使用

graph.partitionBy选择合适的图分区策略(如边分割的CanonicalRandomVertexCut)可以极大提升通信效率。 - 内存管理:GraphX计算过程中,顶点和边数据常驻内存,需合理配置Executor内存,防止OOM。

- 迭代计算优化:对于PageRank等迭代算法,可通过检查点(checkpointing)和序列化优化来提升稳定性与速度。

- 算法近似:对于介数中心性等计算代价极高的算法,可采用基于抽样的近似算法来平衡精度与性能。

结论

以中心性算法为代表的图算法是Spark大数据分析能力向关系深度挖掘延伸的重要体现。通过GraphX,我们能够构建从数据预处理、图建模、并行计算到结果输出的端到端流程。尽管面临规模与复杂度的挑战,但通过合理的架构设计、算法选择与性能调优,Spark已然成为处理海量图数据、洞察复杂系统关键节点的强大工具。随着Spark与图神经网络等技术的进一步融合,其在大图数据分析领域的潜力将更加可期。

如若转载,请注明出处:http://www.wekaxs.com/product/4.html

更新时间:2026-06-05 03:00:15