阿里云AI算力产品价格上调背后 芯片与数据处理成本的硬约束

阿里云宣布其部分AI算力产品价格显著上调,部分产品涨幅甚至高达34%,在业界引发了广泛关注。作为国内云计算与人工智能服务的核心提供商,此次调价并非孤立事件,其背后折射出全球AI基础设施,特别是高端AI芯片与大规模数据处理环节,正面临日益严峻的成本与供应链挑战。而最关键的原因,正指向支撑AI算力的核心硬件——高性能AI加速芯片(如GPU)的供需失衡与成本攀升,以及随之而来的数据处理链条的全面承压。

核心驱动力:AI芯片的“稀缺性”与成本高企

AI算力的基石是高性能计算芯片,尤其是英伟达(NVIDIA)等厂商生产的GPU。随着全球范围内生成式AI和大模型训练的爆发式增长,对这类芯片的需求呈现指数级飙升,而供应却受到技术壁垒、产能限制和地缘政治等因素的严重制约。

- 供需严重失衡:以训练ChatGPT等大模型所需的H100、A100等高端GPU为例,其全球需求远超当前产能,导致市场长期处于“一卡难求”的状态。这种稀缺性直接推高了芯片的采购成本。云服务商作为大规模采购方,虽然有一定议价能力,但整体成本的传导不可避免。

- 技术迭代与替代成本:在外部限制下,中国云服务商也在积极推动国产AI芯片(如含光、倚天等系列)的研发与应用。构建一个从硬件、软件到生态完全成熟且性能可比肩国际顶尖水平的替代方案,需要巨大的研发投入和时间成本。在过渡期内,多元化的供应链策略(结合使用国际与国产芯片)本身也可能增加复杂性和部分成本。

- 电力与散热成本:新一代AI芯片算力密度极高,其运行耗电量巨大,伴随产生的散热需求也呈几何级数增长。数据中心为此需要升级供电和冷却系统,这些基础设施的投入与运营成本最终都会计入算力服务的总成本中。

连锁反应:数据处理全链条成本攀升

AI芯片成本的上涨,如同投入湖面的石子,涟漪效应波及整个数据处理流程。AI算力服务并非仅仅是提供一块芯片,而是一个涵盖数据存储、传输、预处理、训练、推理及模型部署的完整服务体系。

- 数据存储与传输成本:大模型训练需要处理海量(PB乃至EB级)数据。存储这些数据需要高性能、高可靠性的存储系统,而数据在不同计算节点间的高速传输则需要极致的网络带宽。芯片性能提升后,为了不使其“饿死”(等待数据),配套的存储和网络设施必须同步升级,这部分投资巨大。

- 软件栈与运维复杂度:高效利用昂贵的AI硬件,需要与之深度优化的软件栈、调度系统和开发框架。开发和维护这套复杂的软件生态,需要顶尖的工程师团队,其人力成本同样高昂。确保大规模AI集群的稳定高效运行,运维难度和成本也随之陡增。

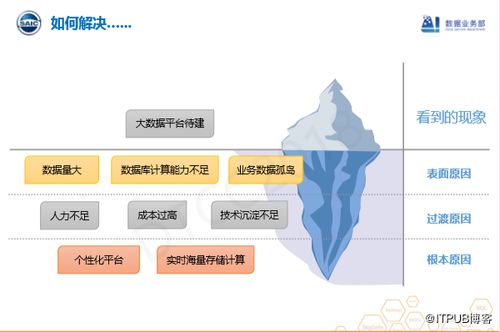

- 规模经济效应的新平衡:云计算原本依托规模经济来降低单位成本。但在AI算力领域,硬件成本的飙升速度可能暂时超过了规模扩张带来的成本摊薄效应。当核心元器件的成本成为不可压缩的刚性支出时,服务商为了维持健康的商业运营和持续投入研发,价格调整便成为一项现实选择。

行业影响与未来展望

阿里云的此次调价,很可能是行业趋势的一个信号。其他云服务厂商同样面临相似的成本压力,未来可能会有更多企业根据自身成本结构进行价格策略的调整。这预示着,AI算力正从早期的“普惠性”基础设施,逐渐转向一个更能反映其真实资源消耗和稀缺性的市场定价阶段。

对于用户而言,这意味着使用尖端AI算力的直接成本将会增加。企业需要更精细地评估AI项目的投入产出比,优化模型架构和资源使用效率,例如更多地采用模型微调而非全量训练,或利用混合云策略灵活调配算力。

长远来看,解决成本问题的根本出路在于技术创新与供应链多元化。一方面,通过芯片架构创新(如存算一体、新型低功耗设计)、模型算法优化(提升计算效率)来降低单位算力的成本;另一方面,推动国产AI芯片生态的成熟与壮大,是构建稳定、可持续且成本可控的AI算力基座的战略关键。

阿里云AI算力产品的价格上涨,其最关键的触发点确实是作为“数字时代原油”的AI芯片的供需与成本困局,并由此引发了数据处理全链条的成本重构。这既是当前AI产业爆发式增长带来的“甜蜜烦恼”,也倒逼着整个行业向更高效、更自主、更可持续的方向加速演进。

如若转载,请注明出处:http://www.wekaxs.com/product/13.html

更新时间:2026-05-06 10:35:09